LFM2.5-350M, il nuovo foundation model per l'Edge Computing

28T tokens

Liquid AI ha reso disponibili LFM2.5-350M e la sua variante Base, modelli open-weight da 350 milioni di parametri. Questa release punta a ottimizzare le pipeline di on-device AI, fornendo una soluzione compatta per elaborazioni locali e dispositivi con risorse limitate, mantenendo la compatibilità con i principali engine di inference.

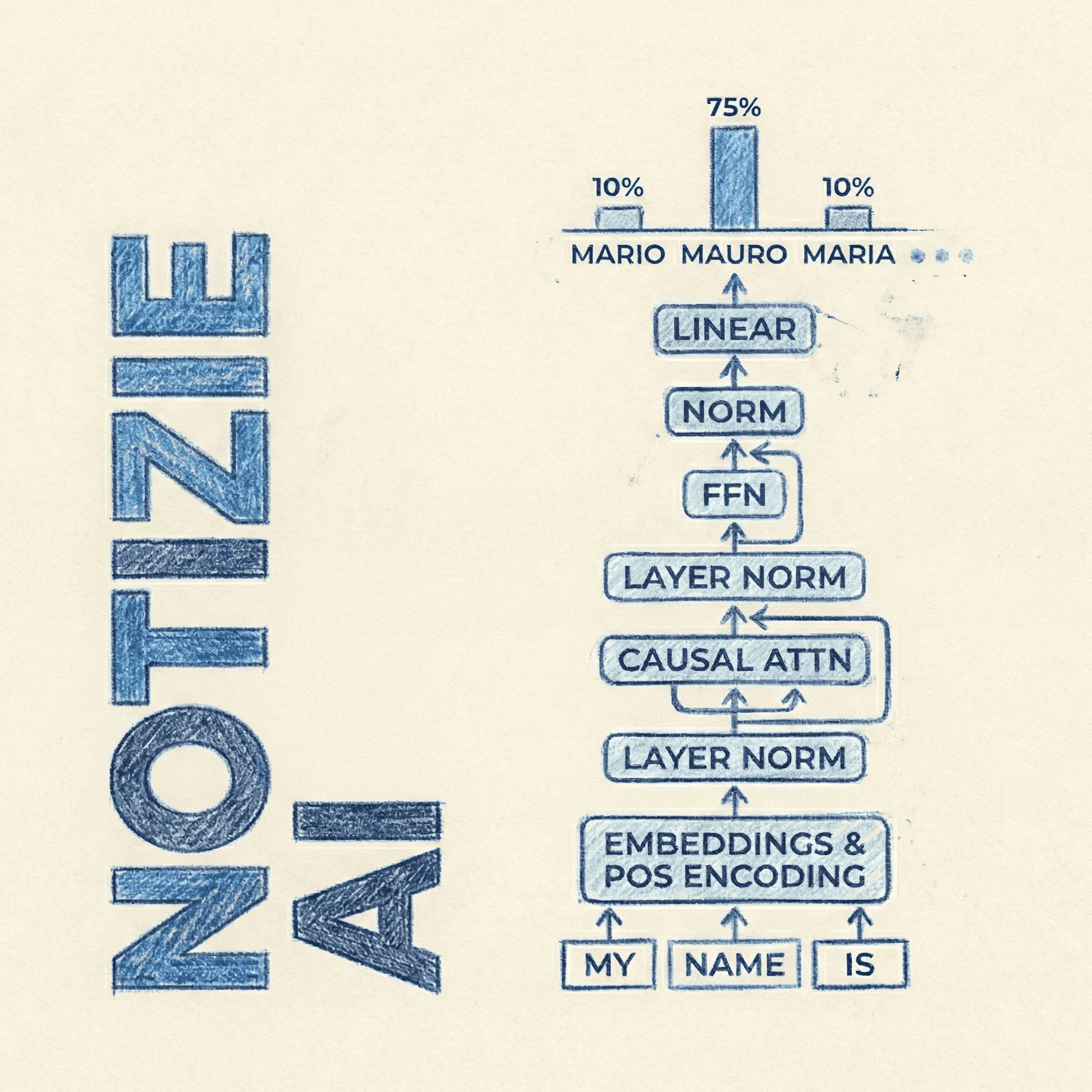

Architettura e Pre-training

Basato sull'architettura LFM2, il modello è stato sottoposto a una fase di pre-training su un dataset di 28T tokens, un incremento sostanziale rispetto ai 10T utilizzati per la versione precedente.

La fase di post-training integra tecniche di reinforcement learning "su larga scala". Queste ottimizzazioni rendono l'architettura particolarmente adatta per task di tool use, data extraction e generazione di structured outputs. I ricercatori sconsigliano esplicitamente l'impiego del modello per ragionamenti matematici, coding o creative writing.

Benchmark sulle Core Capabilities

Le valutazioni documentano un miglioramento generazionale rispetto al predecessore, in particolar modo sull'instruction following (il punteggio IFBench passa da 18.20 a 40.69). Di seguito il confronto con modelli di dimensioni simili o architetture alternative:

| Model | GPQA Diamond | MMLU-Pro | IFEval | IFBench | Multi-IF |

|---|---|---|---|---|---|

| LFM2.5-350M | 30.64 | 20.01 | 76.96 | 40.69 | 44.92 |

| LFM2-350M | 27.58 | 19.29 | 64.96 | 18.20 | 32.92 |

| Granite 4.0-H-350M | 22.32 | 13.14 | 61.27 | 17.22 | 28.70 |

| Qwen3.5-0.8B (Instruct) | 27.41 | 37.42 | 59.94 | 22.87 | 41.68 |

| Gemma 3 1B IT | 23.89 | 14.04 | 63.49 | 20.33 | 44.25 |

Data Extraction e Tool Use

LFM2.5-350M è stato progettato per supportare pipeline agentiche leggere. I test su task applicati mostrano un aumento rilevante in metriche chiave per l'estrazione dati, come CaseReportBench (passato da 11.67 a 32.45), e per le chiamate a funzioni esterne, come BFCLv3 (da 22.95 a 44.11).

| Model | CaseReportBench | BFCLv3 | BFCLv4 | 𝜏²-Bench Telecom | 𝜏²-Bench Retail |

|---|---|---|---|---|---|

| LFM2.5-350M | 32.45 | 44.11 | 21.86 | 18.86 | 17.84 |

| LFM2-350M | 11.67 | 22.95 | 12.29 | 10.82 | 5.56 |

| Granite 4.0-H-350M | 12.44 | 43.07 | 13.28 | 13.74 | 6.14 |

| Qwen3.5-0.8B (Instruct) | 13.83 | 35.08 | 18.70 | 12.57 | 6.14 |

| Gemma 3 1B IT | 2.28 | 16.61 | 7.17 | 9.36 | 6.43 |

Ecosistema e Partnership Hardware

Il modello garantisce un supporto day-one per numerosi framework di inference, tra cui LEAP, llama.cpp (tramite file GGUF), MLX, vLLM, SGLang, ONNX e OpenVINO.

Le partnership hardware assicurano ottimizzazioni native su piattaforme eterogenee. Il supporto copre i processori AMD Ryzen AI, le NPU Qualcomm Snapdragon (grazie a Zetic Melange e RunAnywhere), l'ecosistema Intel via OpenVINO e l'hardware Apple Silicon sfruttando l'engine Mirai.

Sul versante software, Distil Labs ha dimostrato come il fine-tuning del modello per workflow agentici consenta di superare il 95% di accuratezza nel tool-calling. LM Studio facilita inoltre il deployment locale tramite il demone headless llmster.

Potete trovare la model card completa di LFM2.5-350M su HuggingFace.

Metriche di Inference e Throughput

In ambienti server ad alta concorrenza, testati con SGLang 0.5.9 su una singola GPU NVIDIA H100 SXM5, il modello tocca un throughput di picco di 40.4K output tokens per second in precisione BF16. Questo valore si traduce in una capacità di elaborazione superiore a 3.5 miliardi di token giornalieri.

In scenari edge, l'integrazione con il Cactus Engine ottimizza l'allocazione della RAM per l'esecuzione su hardware economico. Di seguito i benchmark di velocità registrati con 1K prefill tokens e 100 decode tokens:

| Device | Processor | Framework (Precision) | Prefill (tok/s) | Decode (tok/s) | Peak Memory |

|---|---|---|---|---|---|

| Apple M5 Max | GPU | Mirai (bf 16) | 44.8K | 564 | 1 GB |

| AMD Ryzen™ AI Max 395+ | CPU | llama.cpp (Q4) | 2.9K | 313 | 434 MB |

| Apple A18 Pro | GPU | Mirai (bf 16) | 1,953 | 73 | 945 MB |

| Snapdragon® 8 Elite (S25 Ultra) | GPU | RunAnywhere (Q4) | 5.3K | 62 | 81 MB |

| Snapdragon® 8 Elite (S25 Ultra) | NPU | RunAnywhere (Q4) | 2.8K | 15 | 169 MB |

| Raspberry Pi 5 | CPU | Cactus Engine (int 8) | 200 | 30 | 300 MB |

A presto!