Microsoft Rilascia harrier-oss-v1: Nuovi Modelli SOTA per Multilingual Text Embeddings

94 lingue!

Microsoft ha appena presentato harrier-oss-v1, famiglia open source di modelli embedding multilingua con ben 94 lingue supportate.

harrier-oss-v1 si presenta nelle varianti da 270m, 0.6b e 27b, posiziondosi immediatamente al vertice delle classifiche, registrando risultati state-of-the-art sul benchmark Multilingual MTEB v2. Un bell'upgrade per chi sviluppa architetture RAG e sistemi di ricerca semantica.

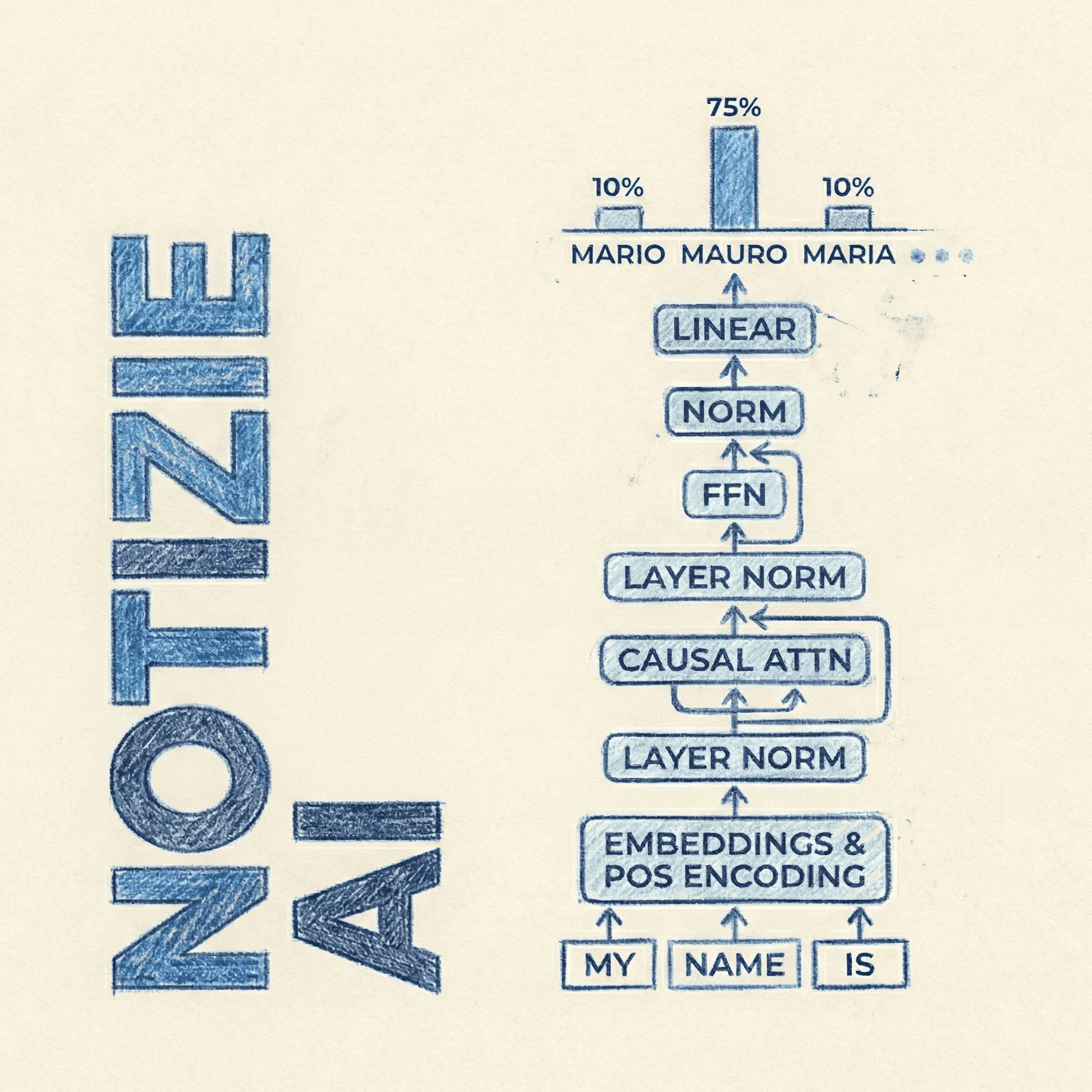

L'intera linea harrier-oss-v1 si basa su architettura decoder-only, di conseguenza è una scelta naturale utilizzare il "last-token pooling" combinato con normalizzazione L2 per estrarre gli embeddings testuali.

Le applicazioni pratiche coprono i principali scenari di information retrieval e analisi testuale. I modelli sono infatti ottimizzati per task impegnativi come il clustering, la semantic similarity, la classification, il bitext mining e il reranking. La capacità di gestire dataset multilingua mantenendo un'elevata coerenza rappresentativa è il loro vero punto di forza.

La release prevede tre varianti, tutte accomunate da un'ampia finestra di contesto di 32.768 tokens. Questa capacità estesa permette teoricamente di processare documenti molto lunghi senza la necessità di complicate logiche di chunking. Nella pratica, come di consueto, bisogna sperimentare con il proprio caso d'uso.

Ecco una tabella riassuntiva dei 3 modelli:

| Modello | Parametri | Embedding Dimension | Max Tokens | MTEB v2 Score |

|---|---|---|---|---|

| harrier-oss-v1-270m | 270M | 640 | 32,768 | 66.5 |

| harrier-oss-v1-0.6b | 0.6B | 1,024 | 32,768 | 69.0 |

| harrier-oss-v1-27b | 27B | 5,376 | 32,768 | 74.3 |

Come di consueto, le varianti più contenute da 270m e 0.6b sono state addestrate tramite knowledge distillation a partire dai logit del fratello più grande.

I pesi (weights) di tutti i modelli sono già disponibili su Huggingface (assicuratevi di installare l'ultima versione in caso di problemi nel caricamento). Link alle model card in fondo all'articolo.

Come utilizzare harrier-oss-v1 ?

Ecco qui un esempio concreto di come utilizzare harrier-oss-v1 con la libreria SentenceTransformers.

Nello specifico, le query hanno bisogno di essere costruite inserendo un prompt all'inizio: Instruct: <prompt>\nQuery: <Query>.

Il prompt può essere sia specificato tra quelli supportati ufficialmente:

"prompts": {

"web_search_query": "Instruct: Given a web search query, retrieve relevant passages that answer the query\nQuery: ",

"sts_query": "Instruct: Retrieve semantically similar text\nQuery: ",

"bitext_query": "Instruct: Retrieve parallel sentences\nQuery: "

}

o liberamente tramite model.encode(.., prompt="Instruct: ..")

Mettendo insieme i pezzi, facciamo una prova con microsoft/harrier-oss-v1-270m:

from sentence_transformers import SentenceTransformer

model = SentenceTransformer("microsoft/harrier-oss-v1-270m", model_kwargs={"dtype": "auto"})

queries = [

"quanta acqua bere al giorno",

"definizione di resilienza",

]

documents = [

"In linea generale, le linee guida per una corretta alimentazione suggeriscono che un adulto dovrebbe bere circa 2 litri di acqua al giorno (circa 8 bicchieri). Tuttavia, questo valore può variare considerevolmente in base al peso corporeo, al livello di attività fisica e alle condizioni climatiche esterne.",

"Il termine resilienza può avere diverse sfaccettature: 1. In psicologia, la capacità di un individuo di affrontare e superare un evento traumatico o un periodo di difficoltà. 2. In tecnologia dei materiali, la capacità di un materiale di assorbire energia di deformazione elastica. 3. In ecologia, la velocità con cui una comunità biotica ripristina il proprio stato iniziale dopo una perturbazione."

]

query_embeddings = model.encode(queries, prompt_name="web_search_query")

document_embeddings = model.encode(documents)

scores = (query_embeddings @ document_embeddings.T) * 100

print(scores.tolist())

E' tutto per oggi, alla prossima!