GPT-5.4 di OpenAI: Benchmark, Costi e Capacità Agentiche

OpenAI ha appena annunciato il rilascio di GPT-5.4, il nuovo e attesissimo membro della famiglia GPT-5 progettato per dominare i flussi di lavoro professionali complessi, la programmazione avanzata e l'utilizzo di strumenti software. Questa nuova iterazione punta a dimostrare che l'IA può agire come un vero e proprio agente autonomo, portando capacità di ragionamento estremo direttamente a sviluppatori e aziende che necessitano di precisione assoluta e meno iterazioni correttive.

Comunque sia, le API di questa fascia costano parecchio. Al momento della stesura di questo articolo, OpenAI posiziona chiaramente questo modello per il segmento premium, puntando ai professionisti e sfidando frontalmente le soluzioni enterprise concorrenti di Anthropic.

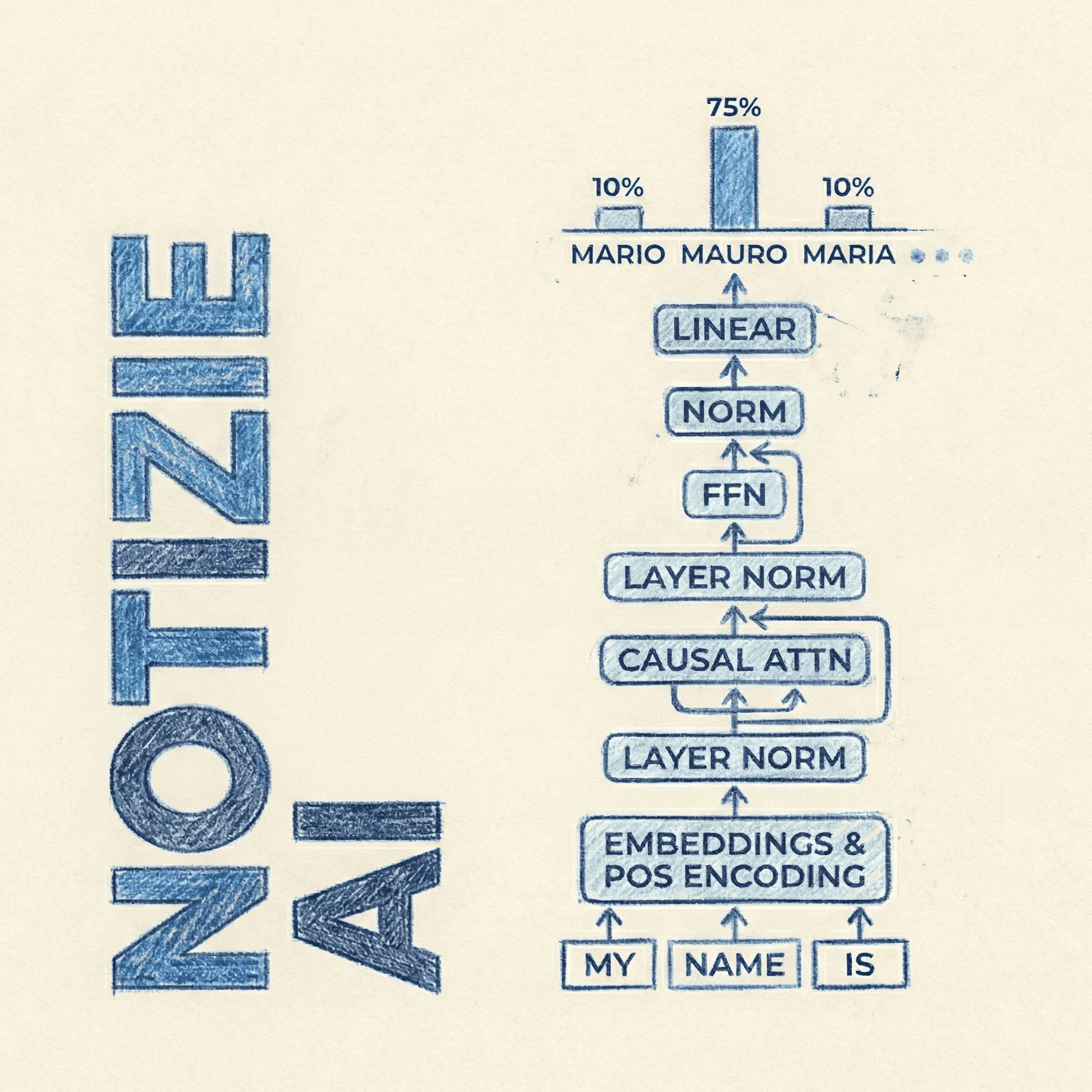

Un'architettura ottimizzata per l'uso professionale e gli agenti

Il cuore dell'annuncio per questa release risiede nell'affidabilità e nella capacità di gestire task a lungo termine senza deviare dall'obiettivo. A differenza delle versioni precedenti o dei modelli "mini" pensati per la velocità bruta, GPT-5.4 adotta un'infrastruttura super-ottimizzata per il tool use, la navigazione web profonda e l'interazione con ambienti software.

Questo risultato ingegneristico permette al modello di abbattere radicalmente gli errori in contesti multi-step. A questo si aggiunge la straordinaria capacità di gestire un'immensa finestra di contesto da 1.050.000 token, permettendo di elaborare senza sforzo intere codebase strutturate, ore di meeting o vasti documenti finanziari, il tutto mantenendo intatta la coerenza logica.

Le capacità multimodali e agentiche di GPT-5.4

La release è pensata per fungere da workhorse (cavallo da battaglia) definitivo per le esigenze lavorative avanzate. La capacità di gestire input complessi e agire in autonomia è sulla carta formidabile:

- Sviluppo e Codice: Integra nativamente le incredibili capacità di GPT-5.3-Codex. È perfetto per generare, revisionare e testare codice all'interno di ambienti isolati o direttamente nei flussi CI/CD.

- Ricerca e Analisi: Strumenti integrati migliorati per la ricerca web e l'analisi di fogli di calcolo, rendendolo ideale per la due diligence e compiti tipici di un analista finanziario.

- Computer Use e Task Agenti: Ottimizzato per agire come agente indipendente, interfacciandosi con il terminale o le applicazioni aziendali, supportando in output la massiccia cifra di 128.000 token.

Ragionamento Estremo e Pianificazione Anticipata

Il vero punto di svolta tecnologico di GPT-5.4 è l'introduzione di un sistema di ragionamento potenziato e visibile. Quando affronta un problema complesso in ChatGPT, il modello ora può esporre un piano di lavoro in anticipo (upfront plan), permettendovi di correggere la rotta mentre sta ancora ragionando, evitando di dover scartare l'intero output finale se l'impostazione iniziale era errata.

Via API, OpenAI permette agli sviluppatori di regolare esattamente quanto il modello deve "pensare" prima di rispondere, offrendo ben cinque livelli di intensità tramite il parametro reasoning_effort: none, low, medium, high e l'inedito xhigh (extreme).

Questa funzionalità vi permette di bilanciare il costo e il tempo computazionale con la necessità di precisione logica per i compiti più critici.

Benchmark da pesi massimi

I risultati dimostrano che questo modello surclassa i pesi massimi delle generazioni precedenti (inclusi GPT-5.2 e il recente GPT-5.3-Codex) nei compiti professionali, nella scrittura di codice reale e nell'utilizzo di tool.

Ecco i risultati dei test per GPT-5.4 (messi a confronto con le versioni precedenti):

- GDPval (wins or ties): 83.0% (vs 70.9% di 5.3-Codex e 5.2). Dimostra la capacità del modello di raggiungere o superare le prestazioni di esperti umani in 44 professioni diverse.

- SWE-Bench Pro (Public): 57.7% (vs 56.8% e 55.6%). Risultato solido per la risoluzione autonoma di veri problemi software e bug su repository GitHub.

- OSWorld-Verified: 75.0% (vs 74.0% e 47.3%). Altissima competenza nell'uso del computer e nell'interazione nativa con i sistemi operativi per completare task reali.

- Toolathlon: 54.6% (vs 51.9% e 46.3%). Evidenzia una padronanza decisamente superiore nell'utilizzo coordinato e sequenziale di strumenti esterni (API, funzioni).

- BrowseComp: 82.7% (vs 77.3% e 65.8%). Un salto in avanti notevole nella navigazione autonoma e nell'estrazione di informazioni complesse dal web.

Costi premium per un ecosistema premium

A differenza della guerra dei prezzi che caratterizza la fascia medio-bassa del mercato, questa release dimostra che OpenAI punta alla monetizzazione del valore aziendale (potenzialmente) generato. I costi di API per GPT-5.4 lo posizionano nella fascia high-end, pensato per le applicazioni in cui la qualità conta più del risparmio sul singolo token:

- $2.50 per 1 milione di token in input.

- $0.25 per 1 milione di token se l'input è Cached (memorizzato nella cache per chiamate ripetute).

- $15.00 per 1 milione di token in output.

È una scelta ovvia per OpenAI: la competizione in questa specifica nicchia di ragionamento "estremo" si gioca contro modelli altrettanto costosi (come la gamma Opus di Anthropic), dove le aziende sono disposte a pagare un premium per avere un assistente virtuale affidabile e competente.

Esempi di utilizzo per GPT-5.4

Puoi installare la libreria ufficiale con pip o uv: uv add openai

1. Generazione di testo semplice e direttive strutturate

from openai import OpenAI

import os

# Inizializza il client (pesca in automatico OPENAI_API_KEY dalle variabili d'ambiente)

client = OpenAI()

response = client.chat.completions.create(

model='gpt-5.4',

messages=[

{"role": "system", "content": "Sei un consulente aziendale esperto. Rispondi usando un elenco puntato singolo, senza annidamenti."},

{"role": "user", "content": "Spiega i vantaggi dell'automazione AI per l'ottimizzazione dei costi IT in tre brevi punti."}

]

)

print(response.choices[0].message.content)

2. Analisi Avanzata (Sfruttare il contesto da 1 Milione di token)

from openai import OpenAI

client = OpenAI()

# Simulazione di un contenuto massivo (es. un intero repository di codice o un bilancio annuale)

documento_massivo = "... [Testo molto lungo] ..."

response = client.chat.completions.create(

model='gpt-5.4',

messages=[

{"role": "system", "content": "Sei un analista finanziario rigoroso. Modalità di ricerca attiva."},

{"role": "user", "content": f"Analizza questo documento ed estrai le metriche di spesa del Q3. Ecco i dati:\n\n{documento_massivo}"}

]

)

print(response.choices[0].message.content)

3. Configurazione avanzata (Personalizzare il Reasoning Effort)

from openai import OpenAI

client = OpenAI()

response = client.chat.completions.create(

model='gpt-5.4',

messages=[

{"role": "system", "content": "Sei un ingegnere software specializzato in sicurezza."},

{"role": "user", "content": "Analizza questo script per vulnerabilità zero-day e proponi una patch robusta."}

],

# --- Configurazione del Thinking / Reasoning ---

# Livelli supportati: low, medium, high, xhigh

# Per task di logica algoritmica severa, 'high' o 'xhigh' offrono risultati superiori

reasoning_effort="high",

max_completion_tokens=15000

)

print(response.choices[0].message.content)

4. Estrazione Dati Strutturata (Tool Calling per PDF)

Quando devi estrarre informazioni da centinaia di PDF aziendali (come fatture o contratti) ti serve un output strutturato, pronto per essere inserito in un database.

Utilizzando il Tool Calling (o Function Calling), possiamo definire uno schema JSON rigido e forzare GPT-5.4 a rispettarlo alla lettera, abbattendo le allucinazioni di formato.

In questo esempio, simuliamo l'estrazione dei dati da una fattura (il cui testo è stato precedentemente estratto dal PDF tramite librerie come PyPDF2 o un OCR).

from openai import OpenAI

import json

client = OpenAI()

# 1. Definiamo lo schema del nostro "Tool" (la struttura dati che vogliamo in output)

strumenti = [

{

"type": "function",

"function": {

"name": "estrai_dati_fattura",

"description": "Estrae i dati strutturati essenziali da una fattura.",

"parameters": {

"type": "object",

"properties": {

"ragione_sociale": {"type": "string", "description": "Nome dell'azienda fornitrice"},

"importo_totale": {"type": "number", "description": "Importo totale da pagare"},

"partita_iva": {"type": "string", "description": "Partita IVA del fornitore"},

"scadenza_pagamento": {"type": "string", "description": "Data nel formato YYYY-MM-DD"}

},

# Rendiamo obbligatori i campi chiave

"required": ["ragione_sociale", "importo_totale"]

}

}

}

]

# Testo grezzo estratto dal nostro PDF

testo_pdf = """

Fattura N. 1042 - Data: 15 Ottobre 2025

Fornitore: TechCloud Solutions S.p.A. - P.IVA: 12345678901

Servizi Cloud Q3: € 4.500,00

Totale da pagare: € 4.500,00

Scadenza: 15 Novembre 2025

"""

# 2. Chiamiamo GPT-5.4 forzando l'uso del tool

response = client.chat.completions.create(

model='gpt-5.4',

messages=[

{"role": "system", "content": "Sei un data-entry agent. Estrai i dati dal testo fornito."},

{"role": "user", "content": f"Analizza questo testo estratto da un PDF:\n\n{testo_pdf}"}

],

tools=strumenti,

# Forziamo esplicitamente il modello a usare la nostra funzione

tool_choice={"type": "function", "function": {"name": "estrai_dati_fattura"}},

# Per task di pura estrazione, abbassiamo il reasoning per risparmiare tempo e costi, prova pure "medium" "high" o "xhigh"

reasoning_effort="low"

)

# 3. Recuperiamo l'output strutturato

dati_grezzi = response.choices[0].message.tool_calls[0].function.arguments

dati_strutturati = json.loads(dati_grezzi)

print("✅ Dati estratti e validati:")

print(json.dumps(dati_strutturati, indent=4))

Deployment Day-Zero

Mantenendo l'impegno verso un'adozione immediata per i professionisti, il team di OpenAI ha reso GPT-5.4 subito disponibile sia su ChatGPT che Codex.

Gli sviluppatori possono iniziare a lavorarci oggi stesso tramite la OpenAI API e la piattaforma sviluppatori. Per gli utenti finali, le nuove capacità di Thinking sono già integrate in ChatGPT. Una menzione d'onore va all'integrazione nell'app Codex per Windows, che regala agli sviluppatori un ambiente desktop nativo per far girare più agenti in parallelo, gestendo branch isolati e diff di codice con alta UX.