Google annuncia Gemini 3.1 Flash Lite (Preview)

$0.25 input $1.50 output ..

Google ha appena annunciato il rilascio di Gemini 3.1 Flash-Lite codename gemini-3.1-flash-lite-preview, il nuovo e attesissimo membro della famiglia Gemini 3 progettato per dominare le operazioni ad altissimo volume e abbattere i costi dell'AI generativa. Questa nuova iterazione punta a dimostrare che l'IA di altissima qualità non richiede necessariamente budget esorbitanti, portando velocità estrema e capacità multimodali avanzate direttamente a sviluppatori e aziende che necessitano di scalabilità pura.

Comunque sia, io aspetto Gemini 3 in disponibilità generale (GA). Al momento della stesura di questo articolo tutti i modelli della famiglia 3 sono ancora in preview.

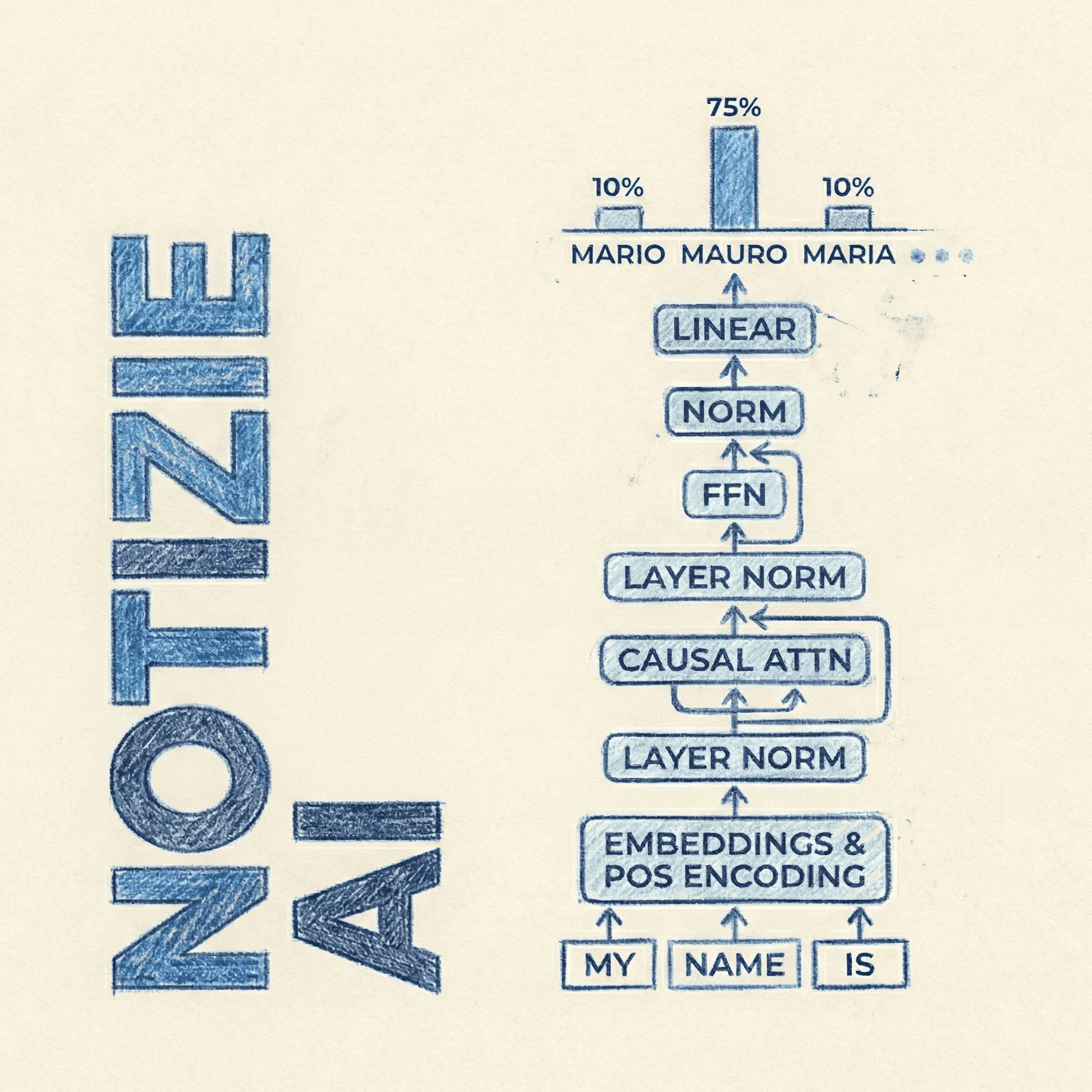

Un'architettura ottimizzata per l'efficienza e la latenza

Il cuore dell'annuncio per questa fascia "Lite" risiede nella velocità di esecuzione. A differenza dei fratelli maggiori (come Gemini 3.1 Pro) pensati per ragionamenti estremamente complessi, Flash-Lite adotta un'infrastruttura super-ottimizzata per l'elaborazione ad alto throughput.

Questo risultato ingegneristico permette al modello di abbattere radicalmente i tempi di attesa: vanta un Time to First Token (TTFT) fino a 2,5 volte più veloce rispetto al precedente Gemini 2.5 Flash, e un incremento del 45% nella velocità di output. A questo si aggiunge la straordinaria capacità di gestire un'immensa finestra di contesto da 1.000.000 di token, permettendo di elaborare senza sforzo documenti, ore di audio o file video complessi, il tutto mantenendo intatta la precisione.

Le capacità multimodali di Flash-Lite

La release è pensata per fungere da workhorse (cavallo da battaglia) per specifiche esigenze di sviluppo. Nonostante l'etichetta "Lite", la capacità di gestire input complessi è sulla carta formidabile:

- Testo e Documenti: Fino a 3.000 file per prompt o 1.000 pagine per file. È perfetto per la summarization massiva, l'estrazione di dati strutturati e la classificazione.

- Audio e Video: Può elaborare video lunghi fino a 45 minuti (con audio) e file audio singoli fino a 8,4 ore. L'ideale per trascrizioni e traduzioni istantanee.

- Sviluppo UI e Task Agenti: Ottimizzato per generare interfacce utente al volo, supportare la moderazione dei contenuti su larga scala e agire come router super-veloce in pipeline multi-agente, supportando output fino a 64.000 token.

Ragionamento Dinamico: il controllo nelle tue mani

Il vero punto di svolta tecnologico di Gemini 3.1 Flash-Lite è l'introduzione del Dynamic Thinking (Ragionamento Dinamico). Non ha senso sobbarcarsi la latenza di un ragionamento profondo per completare un task banale. Google ora permette agli sviluppatori di regolare esattamente quanto il modello deve "pensare" prima di rispondere, offrendo quattro livelli di intensità: minimal, low, medium e high.

Questa funzionalità vi permette di bilanciare in tempo reale il trade-off tra la qualità logica della risposta e la velocità di esecuzione, garantendo un'esperienza fluida e su misura per ogni specifico caso d'uso.

(Feature disponibile su tutti i modelli dalla serie 3 in poi)

Benchmark da pesi massimi

Non fatevi ingannare dal nome "Lite": i risultati accademici dimostrano che questo modello surclassa i pesi massimi delle generazioni precedenti, incluso 2.5 Flash.

Ecco i risultati dei test (thinking high):

- Velocità di Output: 363 token/s. Latenza minima, ideale per applicazioni in tempo reale, chatbot e flussi multi-agente.

- Humanity's Last Exam: 16.0%. Risultato atteso data la complessità del test (ragionamento accademico estremo senza tool esterni) per un modello di fascia "Lite".

- GPQA Diamond: 86.9%. Ottima padronanza in ambito scientifico (fisica, chimica, biologia) di livello universitario.

- MMMU-Pro: 76.8%. Solide capacità di comprensione e ragionamento su input visivi e testuali combinati.

- CharXiv Reasoning: 73.2%. Affidabile nella lettura, sintesi e interpretazione di grafici informativi complessi.

- Video-MMMU: 84.8%. Elevata competenza nell'estrazione di informazioni e conoscenza direttamente da flussi video.

- SimpleQA Verified: 43.3%. Punteggio moderato sulla conoscenza parametrica pura (nozioni apprese a memoria durante il training).

- FACTS Benchmark Suite: 40.6%. Precisione fattuale media; si consiglia l'abbinamento a sistemi RAG per l'uso su dati critici e specifici.

- MMMLU: 88.9%. Eccellente capacità di comprensione e risposta in contesti multilingua.

- LiveCodeBench: 72.0%. Competenze solide nella generazione di codice recente e interfacce utente.

- MRCR v2 (8-needle, 128k): 60.1%. Discreta efficienza nel recupero di informazioni specifiche all'interno di un contesto lungo fino a 128.000 token.

- MRCR v2 (8-needle, 1M): 12.3%. Flessione fisiologica dell'accuratezza nel recupero puntuale (pointwise) quando si satura la finestra massima di 1 milione di token.

Costi imbattibili per l'ecosistema AI

Questa release dimostra che la battaglia per l'AI si combatte frontalmente sull'accessibilità economica. I costi di API per Gemini 3.1 Flash-Lite abbassano le barriere all'ingresso, rendendolo la scelta definitiva per le applicazioni high-volume:

- $0.25 per 1 milione di token in input.

- $1.50 per 1 milione di token in output.

- $0.50 per 1 milione di token audio in input.

Ricordiamo, tuttavia, che Google a partire da Gemini 2.5 ha aumentato sostanzialmente i prezzi delle API per million-token. Gemini 2.0 flash costa appena 0.40 output, la sua variante flash-lite 0.30 output.

Google ha adottato il classico modello di lock-in con prezzi aggressivi e successivo price bump. E' una scelta ovvia specialmente se sul fronte small-models la competizione è praticamente assente.

Esempi di utilizzo per Gemini 3.1 Flash Lite

Puoi installare la libreria ufficiale con pip o uv: uv add google-genai

1. Generazione di testo semplice

from google import genai

# Inizializza il client (pesca in automatico GEMINI_API_KEY dalle variabili d'ambiente)

client = genai.Client()

response = client.models.generate_content(

model='gemini-3.1-flash-lite-preview',

contents='Spiega i vantaggi dell\'intelligenza artificiale per l\'ottimizzazione dei costi aziendali in tre brevi punti.'

)

print(response.text)

2. Analisi Multimodale (Sfruttare il contesto da 1 Milione di token)

from google import genai

client = genai.Client()

# 1. Carica il tuo file massivo (es. un PDF di centinaia di pagine o un file audio)

documento = client.files.upload(file='report_finanziario_annuale.pdf')

# 2. Passa il file e il prompt al modello

response = client.models.generate_content(

model='gemini-3.1-flash-lite-preview',

contents=[

documento,

'Analizza questo documento e crea un riassunto esecutivo evidenziando solo le metriche di spesa del Q3.'

]

)

print(response.text)

3. Configurazione avanzata (Personalizzare l'output e System Instructions)

from google import genai

from google.genai import types

client = genai.Client()

response = client.models.generate_content(

model='gemini-3.1-flash-lite-preview',

contents='Estrai tutti i nomi di aziende e i relativi fatturati dal seguente testo...',

config=types.GenerateContentConfig(

# Regola la creatività: 0.1 per output deterministici (es. estrazione dati)

temperature=0.1,

max_output_tokens=2048,

# Definisci il comportamento "di base" del modello

system_instruction='Sei un assistente specializzato nell\'estrazione di dati finanziari. Rispondi solo in formato JSON.',

# --- Configurazione del Dynamic Thinking ---

thinking_config=types.ThinkingConfig(

# Livelli supportati: MINIMAL, LOW, MEDIUM, HIGH

# Per task di estrazione netti, un livello LOW o MINIMAL abbatte la latenza.

# Per task più ragionati, puoi salire a MEDIUM o HIGH.

thinking_level=types.ThinkingLevel.LOW,

# (Opzionale) Imposta a True se desideri ispezionare

# i passaggi logici intermedi del modello prima dell'output finale

include_thoughts=False

)

)

)

print(response.text)

Deployment Day-Zero

Mantenendo l'impegno verso un'adozione immediata per i developer, il team di Google ha reso Gemini 3.1 Flash-Lite subito disponibile in preview globale.

Gli sviluppatori possono iniziare a lavorarci oggi stesso tramite la Gemini API all'interno di Google AI Studio in modalità plug-and-play. Per le realtà enterprise il modello è già pronto all'uso su Vertex AI, anche se in preview. Per il rilascio in General Availability (GA) bisognerà attendere qualche mese, come Google è solito fare.