Alibaba lancia la serie Qwen 3.5 Small: varianti dense da 0.8B a 9B

al livello di gpt 5 nano, gemini 2.5 flash lite ma open source

Alibaba Qwen Team ha appena annunciato il rilascio della serie Qwen 3.5 Small, una nuova famiglia di modelli che uniscono visione e linguaggio progettata per dominare l'edge computing e l'intelligenza artificiale on-device. Questa serie, che spazia dagli 0.8B ai 9B di parametri, punta a dimostrare che l'AI di alta qualità non richiede necessariamente server farm energivore, portando capacità di ragionamento avanzate direttamente nei nostri smartphone, laptop e dispositivi IoT.

Voglio sottolineare che la capacità vision è supportata da tutti i modelli di questa release.

Un'architettura ottimizzata per l'edge computing

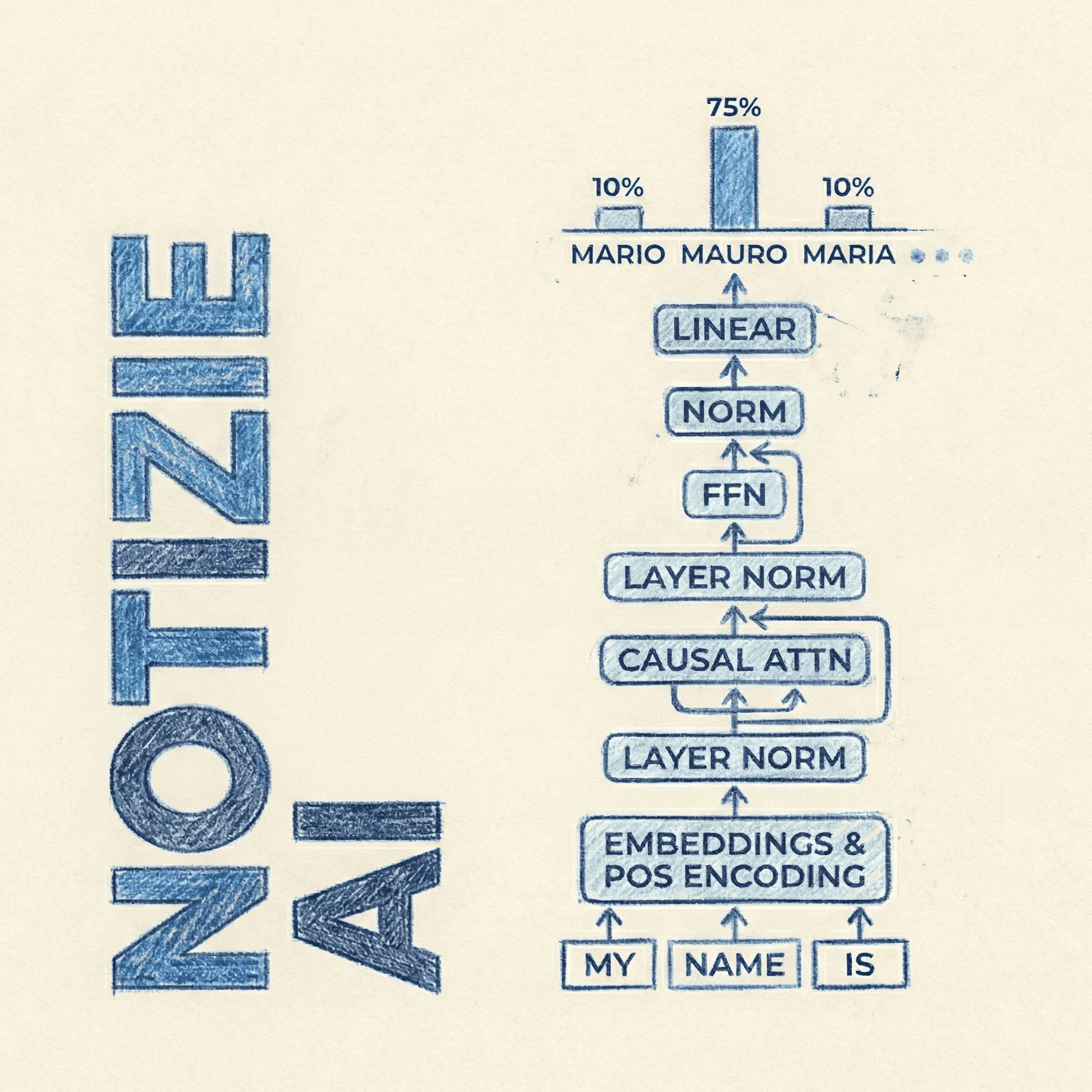

Il cuore dell'annuncio per questa fascia di modelli risiede nella densità e nell'efficienza della memoria. A differenza dei fratelli maggiori che sfruttano architetture MoE massive, la serie Small adotta un'architettura densa super-ottimizzata che fa un uso intelligente delle reti Gated Delta Networks (linear attention) per la gestione efficiente della KV cache.

Questo risultato ingegneristico permette ai modelli compatti di non far esplodere il consumo di memoria all'aumentare dei token, consentendo di elaborare finestre di contesto sorprendentemente ampie (fino a 128.000 token) su dispositivi con hardware limitato. A questo si aggiunge la stessa rigorosa pipeline di post-training basata su Reinforcement Learning (RL) vista nella serie Medium, che conferisce a questi piccoli modelli capacità di instruction-following che di solito ci si aspetta solo dai pesi massimi.

La famiglia Qwen 3.5 Small

La release è composta da diverse varianti open-weight, tutte disponibili su Hugging Face, ciascuna pensata per specifiche esigenze hardware e di deployment:

- Qwen3.5-0.8B: Il "peso piuma" dell'ecosistema. Estremamente veloce e leggerissimo, è progettato per l'Internet of Things (IoT), microcontrollori avanzati o per fungere da router e classificatore super-veloce in pipeline multi-agente.

- Qwen3.5-4B: Il vero punto di svolta per il mondo mobile. Rappresenta lo sweet spot tra capacità cognitive e dimensioni. È ottimizzato per girare nativamente sulle NPU degli smartphone moderni o su Raspberry Pi, offrendo traduzioni in tempo reale, summarization e assistenza testuale con un consumo energetico quasi nullo.

- Qwen3.5-9B: Il "fratello maggiore" della fascia small. Surclassa agevolmente i vecchi modelli open-source da 14B a 20B. È un concentrato di logica, coding e multilinguismo, perfetto per l'esecuzione locale su laptop o PC desktop per task complessi di Retrieval-Augmented Generation (RAG) personale.

Efficienza e Deployment On-Device

Il vero punto di forza della serie Qwen 3.5 Small è l'incredibile accessibilità hardware. Non serve una GPU da svariate migliaia di euro: questi modelli sono pensati per essere eseguiti letteralmente ovunque. Il modello da 9B può comodamente girare in locale su un Mac Apple Silicon con soli 8GB di memoria unificata o su una GPU entry-level (come una RTX 3060/4060).

Grazie all'architettura ottimizzata su un normale laptop o su GPU consumer, si possono raggiungere agilmente i 150 - 300 tokens/s, garantendo un'esperienza fluida e istantanea.

Per facilitare l'adozione day-zero, la serie è subito compatibile con i framework più amati per il mondo local ed edge:

- Unsloth (per quantizzazioni e finetuning ultrarapido anche su schede video vecchie)

- llama.cpp / Ollama (per inferenza locale immediata su GPU, CPU e persino smartphone)

- MLX (il framework di Apple, per spingere al massimo le performance su chip M-series)

Qwen3.5-9B e 4B con Unsloth e Ollama

Su Hugging Face e sulle documentazioni ufficiali potete trovare i file in formato GGUF pronti all'uso, con il consueto supporto di Unsloth per chi desidera addestrare il modello sui propri dati in pochi minuti.

Si consiglia di utilizzare le versioni quantizzate a 4-bit (Q4_K_M). In questo formato, il Qwen3.5-4B occupa appena ~2.5 GB di memoria RAM/VRAM, mentre il potente Qwen3.5-9B ne richiede circa 5.5 GB. Se usate Ollama, l'esperienza è letteralmente plug-and-play. Vi basterà lanciare da terminale:

ollama run qwen3.5:9b oppure ollama run qwen3.5:4b

per avere un assistente reattivo e brillante, completamente offline sul vostro dispositivo.

Punti di forza dell'AI "On-Device" e Privacy-First

Questa release dimostra che la battaglia per l'AI si combatte anche sul fronte dell'accessibilità quotidiana e della sicurezza. La capacità di eseguire modelli da 4B o 9B ad altissime prestazioni localmente rende Qwen 3.5 la scelta definitiva per le applicazioni privacy-first. Nessun dato sensibile, documento privato o conversazione aziendale deve più lasciare il dispositivo per essere elaborato nel cloud. Alibaba sta offrendo agli sviluppatori i mattoni fondamentali per creare assistenti personali nativi, invisibili alla rete esterna, con zero latenza e privacy garantita al 100%.

Licenza Apache 2.0

Esattamente come per la serie Medium, mantenendo il suo forte impegno verso l'ecosistema open source globale, il team di Alibaba ha rilasciato i pesi della serie Qwen 3.5 Small sotto la licenza Apache 2.0.

Si tratta di una licenza estremamente permissiva che garantisce libertà quasi totale. È consentito l'uso commerciale gratuito, la modifica, la riproduzione e la distribuzione (perfetta per essere "impacchettata" all'interno di app mobile a pagamento). Come standard per l'Apache 2.0, non ci sono vincoli sui ricavi dell'azienda (nessuna "soglia"), rendendo questi modelli perfettamente sicuri per essere integrati nel cuore di startup e prodotti enterprise senza la minima preoccupazione legale.